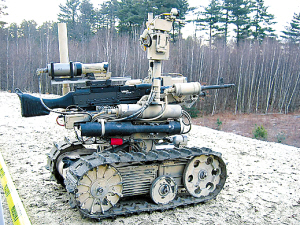

■美國SWORD狙擊機器人能進行精確射擊

戰爭既殘酷又昂貴,這就是為什么美國國防部希望在2015年前用機器人取代其三分之一的戰車和軍人,因為機器人會更適應戰場需求,即便殺人也不會有負罪感,而且“軍方不必向它的親屬發慰問信”。

但美國陸軍仍對機器人存在失控的擔憂,研究人員正在研究如何讓機器人使用致命武力時遵守國際法和交戰規則。有消息稱,自主機器人將在未來20年內正式登上戰場。

“道德適配器”

負責這項研究的羅納德·阿金博士正在制定一套機器人交戰規則,以確保它們能根據道德準則使用致命武力。換句話說,阿金博士正在努力創造一種人工道德意識。他認為,讓機器人上戰場還有另一個原因,那就是它們的舉動可能比人類更有人情味,因為一名士兵可能會受到戰場壓力的影響,而戰場壓力卻不會影響機器人的判斷。

阿金采取的方法就是創造一種被稱為“潛在行動的多維數學決策空間”的軟件系統。據阿金及其同事帕特里克·烏拉姆提交的一份研究報告稱,這套融合了人類悔恨、同情、同意、內疚等情緒的軟件安裝到戰爭機器人后就能扮演“道德適配器”的角色,把機器人所有可能的行動分為“道德”和“不道德”兩種,并根據需要選擇相應武器系統。機器人在使用大威力武器前必須經過“道德適配器”審核,當使用武器的“負罪感”低于標準值才可行動。

阿金舉了一個例子,美軍常用的無人駕駛飛機攜帶有GBU精確制導炸彈,“地獄火”激光制導導彈和機槍,當無人機準備打擊某個目標時,其自帶的“道德適配器”覺察到動用GBU炸彈可能導致平民傷亡,便會及時作出“有罪”判定,GBU武器會被停用,而無人機下一步計劃發射威力更大的“地獄火”導彈時,“道德適配器”將發出更強烈的“有罪”提示,此時由于“有罪”提示達到最大允許量,無人機的武器系統將會失效。

實際上,阿金團隊的工作與上世紀50年代科幻作家阿西莫夫提出的“機器人三定律”有相似之處。但阿西莫夫提出的規則是為了防止機器人在任何情況下傷害人類,而阿金的準則是為了確保機器人不在“不道德”的情況下殺害人類。

不同的意見

美國《華盛頓郵報》預測,用不了20年,美國機器人甚至能從根本上改變“戰爭屠宰場”的面貌,常規戰爭乃至種族滅絕屠殺將因美國“機器人和平部隊”的干預而消失。

但美國學者H.G.韋爾斯是個堅定的“機器人戰爭”反對者,他擔心機器人的知識面廣泛,卻冷酷無情,“機器人與人類的思維差距,就像人類與野獸之間的差距那樣大,它們會產生類似希特勒那樣的種族滅絕情緒”。韋爾斯稱,大多數真人士兵會由于受到戰場壓力影響而很少射擊,其余士兵中的大部分人也只是向大致方向傾瀉子彈,只有約1%的少數士兵會帶著殺意瞄準敵人開火。戰爭機器人的瞄準精確度是人類無法比擬的,而且開火時毫不猶豫,它們一旦上戰場,將使戰爭變得更加殘酷。

對于阿金團隊開發“理智型機器人”,韋爾斯認為這從理論上看是令人欽佩的,但即使道德準則可以編入機器人程序,仍存在一些預料不到的風險。戰場上的情況瞬息萬變,這對于人類和機器人來說都是一個問題。

|